[PT] O que é — e o que não é — um Centro de Excelência em IA (AI CoE)

Feb 20, 2026

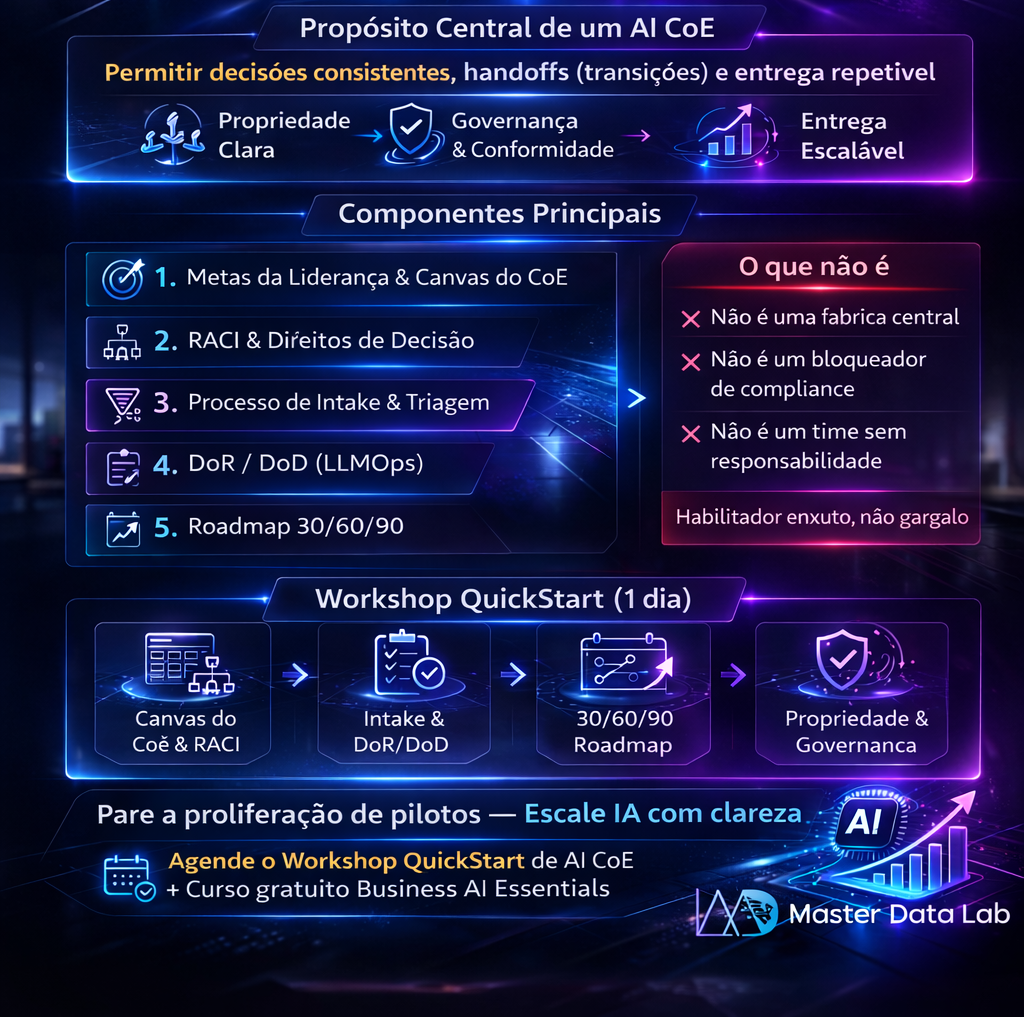

Que problema um AI CoE deve realmente resolver na sua organização?

Quem deve tomar as decisões e quem deve executá-las dentro de um AI CoE?

Como evitar o acúmulo de pilotos e começar a gerar valor em produção?

Em um banco europeu de médio porte, duas equipes desenvolveram modelos promissores. Uma equipe tratou cada modelo como um projeto isolado: pipelines de dados separados, configurações independentes e nenhum handoff claro para operações. A outra equipe definiu um modelo compartilhado simples: intake comum, uma única matriz RACI para aprovações e definições claras de prontidão e conclusão.

Quando um regulador questionou a governança dos modelos, a primeira equipe entrou em modo de crise; a segunda apresentou um trilho de auditoria conciso e um plano de deployment estruturado.

O ponto de virada não foi a tecnologia — foi o modelo operacional.

A liderança alinhou um centro leve para coordenar ownership, reduzir duplicação e estabelecer governança mínima.

A lição: um AI CoE existe para viabilizar decisões consistentes, handoffs claros e entregas repetíveis — não para construir todos os modelos de forma centralizada.

Principais aprendizados

-

Um AI CoE é uma camada operacional que reduz fricção entre estratégia, engenharia e operações.

-

Ele define regras de engajamento (intake, RACI, DoR/DoD) em vez de centralizar toda a entrega.

-

Um alinhamento rápido (por exemplo, um QuickStart Workshop de um dia) acelera clareza e reduz a proliferação de pilotos.

O que é um AI CoE — definição prática

Um AI Center of Excellence (AI CoE) é um modelo operacional multifuncional que padroniza como projetos de IA são propostos, aprovados, construídos e mantidos.

Ele se concentra em três resultados:

-

Clareza de ownership

-

Entrega previsível

-

Governança mínima viável

O CoE fornece artefatos comuns (formulários de intake, CoE Canvas, RACI), playbooks de boas práticas (checklists de LLMOps, DoR/DoD) e uma camada leve de governança para garantir conformidade e reprodutibilidade.

Ele é um habilitador — não um monopólio de entrega.

O que um AI CoE não é

-

Não é uma fábrica que centraliza todo o desenvolvimento de modelos.

-

Não é uma “polícia de compliance” que bloqueia inovação.

-

Não é uma equipe permanente que remove accountability de produto e engenharia.

Mantenha o CoE enxuto: ele deve criar padrões, revisar projetos de alto risco e ajudar as equipes a adotarem padrões repetíveis.

Componentes principais e framework simples

Use um framework compacto para definir responsabilidades e artefatos do CoE.

Framework recomendado de 6 passos para alinhamento QuickStart:

-

Alinhar objetivos da liderança — definir critérios de sucesso do CoE.

-

Definir o CoE Canvas — papéis, serviços, intake e KPIs.

-

Estabelecer RACI para decisões — quem aprova, quem implanta, quem opera.

-

Criar intake + triagem — formulário leve para avaliar risco, prontidão de dados e valor.

-

Definir DoR (Definition of Ready) e DoD (Definition of Done) para LLMOps e entrega de modelos.

-

Construir um roadmap 30/60/90 — priorizar três iniciativas de curto prazo com responsáveis definidos.

Exemplos práticos

Exemplo de intake: formulário de 5 perguntas capturando objetivo de negócio, responsável pelos dados, resultado esperado, flags de compliance e SLA alvo.

Exemplo de RACI:

Product Owner (A), Data Engineering (R), ML Engineers (R), CoE (C), Jurídico/Compliance (I).

DoR/DoD:

DoR inclui disponibilidade e acesso aos dados.

DoD inclui monitoramento implementado e plano de rollback.

Padrões comuns de falha

-

Acúmulo de pilotos sem caminho para produção.

-

Armadilha da centralização: CoE vira gargalo.

-

Falta de direitos de decisão claros.

-

Ausência de disciplina no intake: projetos iniciam sem contrato de dados ou responsáveis.

Checklist — prontidão para lançar um AI CoE

-

Patrocínio da liderança e critérios de sucesso acordados.

-

CoE Canvas de uma página descrevendo escopo e serviços.

-

RACI para decisões e aprovações principais.

-

Processo leve de intake e triagem.

-

Templates de DoR e DoD para LLMOps/entrega de modelos.

-

Roadmap 30/60/90 com responsáveis nomeados.

-

Plano de comunicação e oferta de capacitação para as equipes.

Guardrails & Human-in-the-Loop

Em ambientes de risco médio, implemente guardrails que exijam supervisão humana para decisões de alto impacto e trilhas de auditoria para o comportamento dos modelos.

Siga orientações públicas de gestão de risco e IA responsável, alinhando processos aos conceitos do NIST e às práticas de Responsible AI da Microsoft, AWS e Google para definir gates de revisão e expectativas de documentação.

Utilize padrões de human-in-the-loop para resultados sensíveis (aprovações, overrides, tratamento de incidentes).

O que você recebe no AI CoE QuickStart Workshop

-

Alinhamento executivo sobre missão e critérios de sucesso do CoE

-

CoE Canvas adaptado à sua organização

-

Matriz RACI para ownership e aprovações

-

Template de intake e triagem (exemplo de DoR)

-

Roadmap 30/60/90 com iniciativas priorizadas e responsáveis

Se sua organização está presa no modo piloto, um workshop de um dia pode gerar a clareza necessária: CoE Canvas, RACI, intake e roadmap estruturado para reduzir fricção e acelerar valor em produção.

Agende o QuickStart Workshop e combine com nosso curso gratuito Business AI Essentials para preparar suas equipes para os próximos passos.

FAQ

Precisamos de um CoE se já temos um time de dados?

O CoE complementa o time de dados ao fornecer modelo operacional e framework de decisão que permitem entrega de IA repetível e governada.

O CoE deve ser dono de todo desenvolvimento de IA?

Não. O CoE deve habilitar as equipes com padrões, ferramentas e revisões, mantendo a execução com produto e engenharia.

Em quanto tempo podemos gerar valor?

Com alinhamento focado e um QuickStart workshop, clareza executiva e roadmap inicial podem ser definidos em um dia; a execução evolui em ciclos ágeis.

Referências

- NIST — AI Risk Management Framework — nist.gov

- Microsoft — Responsible AI resources — learn.microsoft.com

- AWS — Well-Architected Machine Learning Lens — docs.aws.amazon.com

- Google Cloud — AI and ML documentation — cloud.google.com

- OpenAI — best practices and safety guidance — platform.openai.com

- IBM — AI governance guidance — ibm.com

Stay connected with news and updates!

Join our mailing list to receive the latest news and updates from our team.